| 摘要:HPE(慧与)将于今年8月推出首款用于人工智能推理的服务器HPE Edgeline EL8000,搭载高通芯片。 |

HPE(慧与)将于今年8月推出首款用于人工智能推理的服务器HPE Edgeline EL8000,搭载高通芯片。

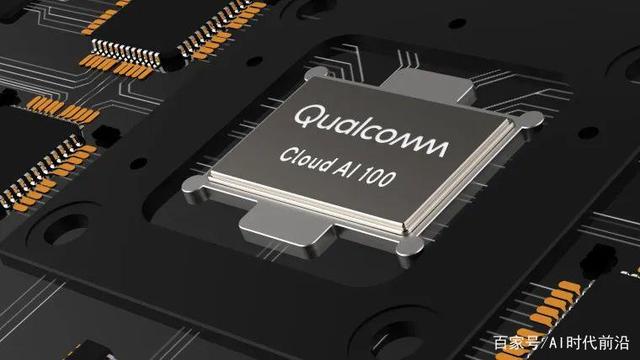

该服务器将采用高通的Cloud AI 100芯片,针对边缘人工智能,成为Edgeline 8000系列平台的一份子。Cloud AI 100芯片在7nm工艺上制作,拥有多达16个“AI核心”,支持FP16、INT8、INT16、FP32数据格式。高通芯片有三种形态,包含标准型以及针对边缘和嵌入式应用的产品。

当进行人工智能推理应用时,实际上的工作量往往比在训练时多得多。在未来的一两年里,HPE将会加大对推理系统的投资。因为应用企业最终会对运营成本非常敏感,而能源性能是推理中的一个重要指标。很多时候,你需要在工厂或零售环境中进行推理,但不具备数据中心所具备的那种能力。显然这些应用场景十分关键。

虽然HPE的战略主要集中在人工智能训练上,但推理方面还有很多事情要做,还有很多有趣的事情要做。从战略上讲,既要进行模型训练,又要进行模型推理和部署,这是同等重要的。

HPE Edgeline EL8000

HPE的重点是人工智能,致力于成为解决庞大问题的计算骨干。

HPE建造了世界上最快的超级计算机“前沿”(Frontier),部署在美国橡树岭国家实验室。这台计算机在hp -AI基准测试中获得了6.86 exaflops(百亿亿次浮点运算)的成绩,成为世界上最快的AI计算机,是世界第二的Fugaku的三倍,Fugaku的基准测试为2 exaflops。

HPE认为数据中心会有不止一个处理器架构,可能会有其他混合存储,不同的存储速度等等。因此将探索一些专门为支持人工智能工作负载而设计的尖端新架构和处理器。

人工智能处理器的HPE实验的一个例子包括一个使用Cerebras系统的人工智能芯片构建的系统,该芯片部署在德国莱布尼茨超级计算中心。HPE将其Superdome Flex服务器与Cerebras的人工智能系统配对,后者有一个名为CS-2的芯片。

该公司还扮演着系统集成商的角色,以填补学术界和企业界之间的空白。学术界开展了大量前沿AI研究,而企业界则在现实世界中部署AI并执行应用。去年,HPE收购了Determined AI,后者为专注于ML开发的新系统提供机器学习开发环境和软件平台。目的是让数据科学家更容易协作和训练深度学习模型。

责任编辑:张华

评论表单加载中...

评论表单加载中...